Metode Klasifikasi Naive Bayes - Data Mining (Bagian 4)

Di Googling - Saat anda membutuhkan algoritma dalam memecahankan masalah yang cepat, algoritma apa yang akan anda pilih? Anda mungkin perlu memilih pengklasifikasi Naive Bayes. Ini adalah algoritma yang cepat dan sederhana yang dapat memecahkan berbagai masalah klasifikasi. Pada artikel ini, kita akan memahami apa itu algoritma naive bayes dan cara kerjanya seperti dibawah ini.

Pengantar Algoritma Naive Bayes

Terlepas dari kemajuan dalam machine learning dalam beberapa tahun terakhir, naive bayes terbukti tidak hanya sederhana tetapi juga cepat, akurat, dan andal.

Algoritman naive bayes Ini telah berhasil digunakan untuk banyak tujuan, tetapi tetap bekerja dengan sangat bagus dalam mengatasi masalah natural language processing (NLP)

Naive Bayes adalah algoritma machine learning probabilistic berdasarkan Teorema Bayes, yang digunakan dalam berbagai tugas klasifikasi. Pada artikel ini, kita akan memahami algoritma Naive Bayes dan contohnya.

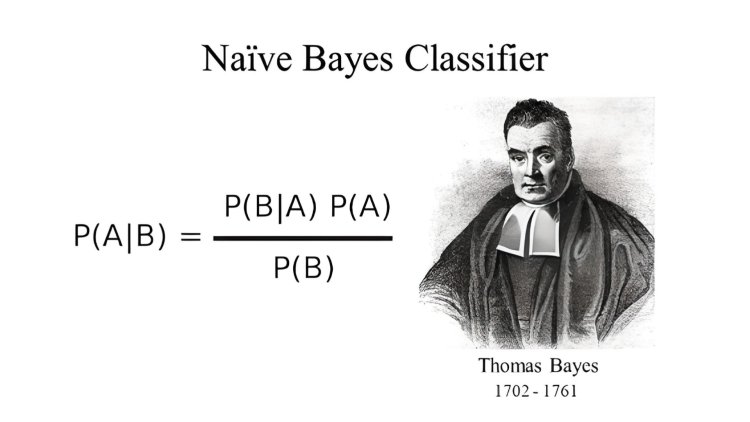

Teorema Bayes

Teorema Bayes adalah rumus matematika sederhana yang digunakan untuk menghitung probabilitas bersyarat. Probabilitas bersyarat adalah ukuran probabilitas suatu peristiwa yang terjadi mengingat peristiwa lain telah terjadi (dengan asumsi, anggapan, pernyataan, atau bukti). Rumusnya adalah:

Yang memberitahu kita: seberapa sering A terjadi mengingat B terjadi , ditulis P(A|B) juga disebut probabilitas posterior, Ketika kita tahu: seberapa sering B terjadi mengingat A terjadi , ditulis P(B|A) dan seberapa besar kemungkinan A sendirinya, ditulis P(A) dan seberapa besar kemungkinan B ditulis sendiri, ditulis P(B).

Dalam istilah yang lebih sederhana, Teorema Bayes adalah cara menemukan probabilitas ketika kita mengetahui probabilitas tertentu lainnya.

Asumsi yang Dibuat oleh Naive Bayes

Asumsi dasar Naive Bayes adalah bahwa setiap fitur meliputi:

- independent

- equal

Mari kita ambil contoh untuk mendapatkan intuisi yang lebih baik. Perhatikan masalah pencurian mobil dengan atribut Color, Type, Origin, dan target, Stolen bisa berupa Yes atau No seperti yang akan dicontohkan dibawah.

Apa yang menjadikan Naive Bayes sebagai algoritme “Naif”?

Pengklasifikasi Naive Bayes mengasumsikan bahwa fitur yang kita gunakan untuk memprediksi target bersifat independen dan tidak saling mempengaruhi. Sedangkan pada data real-life, fitur saling bergantung satu sama lain dalam menentukan target, namun hal ini diabaikan oleh classifier Naive Bayes.

Padahal asumsi independensi tidak pernah benar dalam data dunia nyata, namun sering bekerja dengan baik dalam praktiknya. sehingga disebut “Naif” .

Dimana Implementasi Naive Bayes Digunakan?

Anda dapat menggunakan Naive Bayes untuk hal-hal berikut:

- Pengenalan Wajah: Sebagai classifier, digunakan untuk mengidentifikasi wajah atau fitur lainnya, seperti hidung, mulut, mata, dll.

- Prediksi Cuaca: Ini dapat digunakan untuk memprediksi apakah cuaca akan baik atau buruk.

- Diagnosa medis:Dokter dapat mendiagnosis pasien dengan menggunakan informasi yang disediakan pengklasifikasi. Profesional perawatan kesehatan dapat menggunakan Naive Bayes untuk menunjukkan apakah pasien berisiko tinggi terhadap penyakit dan kondisi tertentu, seperti penyakit jantung, kanker, dan penyakit lainnya.

- Klasifikasi Berita: Dengan bantuan pengklasifikasi Naive Bayes, Google Berita mengenali apakah berita itu politik, berita dunia, dan sebagainya.

Karena Naive Bayes Classifier memiliki begitu banyak implementasi penerapannya, ada baiknya mempelajari lebih lanjut tentang cara kerjanya.

Contoh Naive Bayes

Dataset yang digunakan untuk memberikan contoh algoritma naive bayes direpresentasikan seperti di bawah ini.

Mengenai kumpulan pada data kami, konsep asumsi yang dibuat oleh algoritma dapat dipahami sebagai:

- Kami berasumsi bahwa tidak ada pasangan fitur yang bergantung. Misalnya, warna 'Merah' tidak ada hubungannya dengan Jenis atau Asal mobil. Oleh karena itu, fitur-fiturnya diasumsikan Independen .

- Setiap fitur diberi pengaruh (atau kepentingan) yang sama. Misalnya, mengetahui Warna dan Jenis saja tidak dapat memprediksi hasilnya dengan sempurna. Sehingga tidak ada satupun atribut yang tidak relevan dan diasumsikan memberikan kontribusi yang sama terhadap hasil.

Pada contoh dataset kami gunakan diatas, kami perlu mengklasifikasikan apakah mobil itu dicuri, dengan mempertimbangkan fitur-fitur mobil tersebut. Kolom mewakili fitur-fitur dan baris mewakili entri individual.

Jika kita mengambil dataset baris pertama, kita dapat mengamati bahwa mobil tersebut dicuri jika Warnanya Merah, Tipenya Sport dan Asalnya Domestik.

Jadi kami ingin mengklasifikasikan SUV Domestik Merah dicuri atau tidak. (Perhatikan bahwa tidak ada contoh SUV Domestik Merah di kumpulan data kami).

Menurut contoh tersebut, teorema Bayes dapat ditulis ulang sebagai berikut:

Variabel y adalah variabel kelas (dicuri?), yang menyatakan apakah mobil itu dicuri atau tidak diberi syarat. Variabel X mewakili parameter/fitur.

X diberikan sebagai,

Di sini mewakili fitur-fiturnya, yaitu mereka dapat dipetakan ke Warna, Jenis, dan Asal. Dengan mengganti X dan memperluas menggunakan aturan rantai yang kita dapatkan, x1, x2…, xn.

Sekarang, Anda dapat memperoleh nilai masing-masing dengan melihat dataset dan menggantinya ke dalam persamaan. Untuk semua entri dalam kumpulan data, penyebutnya tidak berubah, tetap statis. Oleh karena itu, penyebutnya dapat dihilangkan dan proporsionalitas dapat disuntikkan.

Dalam kasus kita, variabel kelas (y) hanya memiliki dua hasil, ya atau tidak. Mungkin ada kasus di mana klasifikasi bisa multivariat. Oleh karena itu, kita harus mencari variabel kelas (y) dengan probabilitas maksimum.

Dengan menggunakan fungsi di atas, kita dapat memperoleh kelas, dengan memberikan prediktor/fitur.

Probabilitas posterior P(y|X) dapat dihitung dengan terlebih dahulu membuat Tabel Frekuensi untuk setiap atribut terhadap target. Kemudian, cetak tabel frekuensi menjadi Tabel Kemungkinan dan terakhir, gunakan persamaan Naive Bayesian untuk menghitung probabilitas posterior untuk setiap kelas. Kelas dengan probabilitas posterior tertinggi merupakan hasil prediksi. Di bawah ini adalah tabel Frekuensi dan kemungkinan untuk ketiga prediktor.

Tabel Frekuensi dan Kemungkinan 'Warna'

Tabel Frekuensi dan Kemungkinan 'Jenis'

Tabel Frekuensi dan Kemungkinan 'Asal'

Jadi dalam contoh kita, kita memiliki 3 prediktor X.

Sesuai dengan persamaan yang dibahas di atas, kita dapat menghitung probabilitas posterior P(Ya | X) sebagai:

dan, P(Tidak | X ):

Karena 0,144 > 0,048, Yang berarti mengingat fitur SUV MERAH dan Domestik, contoh kita diklasifikasikan sebagai 'TIDAK' (mobil tidak dicuri).

Jenis Pengklasifikasi Naive Bayes

1. Naive Bayes Multinomial

Vektor fitur mewakili frekuensi peristiwa tertentu yang dihasilkan oleh distribusi multinomial . Ini adalah model kejadian yang biasanya digunakan untuk klasifikasi dokumen, yaitu apakah suatu dokumen termasuk dalam kategori olahraga, politik, teknologi, dll. Fitur/prediktor yang digunakan oleh pengklasifikasi adalah frekuensi kata yang ada dalam dokumen.

2. Bernoulli multivariat

Dalam model kejadian Bernoulli multivariat, fitur adalah boolean independen (variabel biner) yang mendeskripsikan input. Seperti model multinomial naive bayes tetapi prediktornya adalah variabel boolean. Parameter yang kita gunakan untuk memprediksi variabel kelas hanya mengambil nilai ya atau tidak, misalnya jika sebuah kata muncul dalam teks atau tidak.

3. Gaussian Naive Bayes

Dalam Gaussian Naive Bayes, nilai kontinu yang terkait dengan setiap fitur diasumsikan terdistribusi menurut distribusi Gaussian (Distribusi normal ). Ketika diplot, akan memberikan kurva berbentuk lonceng yang simetris terhadap rata-rata nilai fitur seperti yang ditunjukkan di bawah ini:

Kemungkinan fitur diasumsikan sebagai Gaussian, karenanya, probabilitas bersyarat diberikan oleh:

Sekarang, bagaimana jika ada fitur yang berisi nilai numerik, bukan kategori yaitu distribusi Gaussian. Salah satu opsi adalah mengubah nilai numerik menjadi pasangan kategorinya sebelum membuat tabel frekuensinya. Pilihan lain, seperti yang ditunjukkan di atas, dapat menggunakan distribusi variabel numerik untuk mendapatkan perkiraan frekuensi yang baik.

Sebagai contoh, salah satu metode umum adalah mengasumsikan distribusi normal atau gaussian untuk variabel numerik. Fungsi kepadatan probabilitas untuk distribusi normal ditentukan oleh dua parameter (rata-rata dan standar deviasi).

Berikut ini adalah beberapa manfaat pengklasifikasi Naive Bayes:

- Sederhana dan mudah diimplementasikan

- Tidak membutuhkan banyak data pelatihan

- Menangani data kontinu dan diskrit

- Ini sangat terukur dengan jumlah prediktor dan titik data

- Cepat dan dapat digunakan untuk membuat prediksi waktu

- Tidak sensitif terhadap fitur yang tidak relevan

Algoritme Naive Bayes sebagian besar digunakan dalam analisis sentimen, pemfilteran spam, sistem rekomendasi, dll. Algoritma ini cepat dan mudah diterapkan, tetapi kerugian terbesarnya adalah persyaratan prediktor untuk mandiri. Dalam sebagian besar kasus kehidupan nyata, prediktor bergantung, ini menghambat kinerja pengklasifikasi.

Dalam artikel digoogling.com ini kita melihat cara kerja algoritma Naive Bayes beserta jenisnya. Meskipun Naive Bayes memiliki beberapa keterbatasan, ini masih termasuk algoritma klasifikasikan data yang sederhana.